Tras los hechos violentos registrados el domingo pasado en Jalisco, las autoridades detectaron que, en redes sociales, cuentas vinculadas al crimen organizado difundieron imágenes creadas con Inteligencia Artificial y videos sacados de contexto para generar pánico en la población.

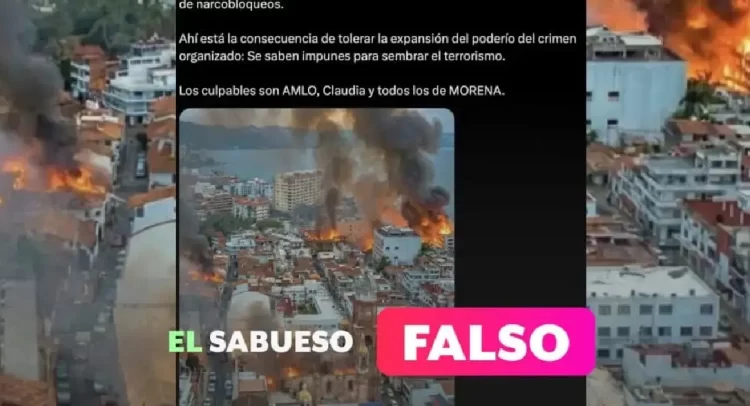

Entre el material falso destaca una escena dantesca en la que, desde el aire, se aprecia la zona cercana a la parroquia de Nuestra Señora Guadalupe, en Puerto Vallarta, envuelta en llamas y con gran parte de la ciudad bajo incendios masivos y columnas de humo negro.

Sin embargo, las autoridades confirmaron que la imagen fue creada con Inteligencia Artificial y que no correspondía a hechos reales, pero circuló como si se retratara la situación actual.

Asimismo, se difundieron imágenes de un avión envuelto en llamas en el Aeropuerto Internacional de Guadalajara. Sin embargo, las autoridades aeroportuarias confirmaron que no se registró ningún incidente real en las instalaciones y que la fotografía corresponde a un accidente ocurrido meses atrás.

Al respecto, especialistas indican que se requiere poner atención a los detalles técnicos que la IA a menudo falla en replicar para identificar este tipo de material apócrifo:

1. Señales visuales de IA (errores comunes)

Deformaciones anatómicas: Busca manos con dedos de más o de menos, orejas distorsionadas, extremidades fusionadas o rostros asimétricos.

Inconsistencias de fondo: Los fondos pueden parecer borrosos, tener formas geométricas repetitivas o elementos incoherentes (por ejemplo, personas sin rostro, estructuras que se derriten).

Texto ilegible: Los letreros, vallas publicitarias o textos en uniformes suelen aparecer como garabatos o letras sin sentido.

Iluminación y sombras: La IA a menudo falla en crear sombras coherentes con la fuente de luz, lo que hace que los objetos parezcan flotar o tener reflejos incorrectos.

Texturas irreales: La piel puede verse demasiado lisa (“efecto plástico”) o, por el contrario, con detalles excesivos y extraños.

2. Verificación de contexto y origen.

Búsqueda inversa de Imágenes: Utiliza herramientas como Google Lens, TinEye o Yandex para rastrear la imagen. Si la imagen aparece como antigua o de un contexto totalmente diferente (ejemplo un incendio en otro país), es un montaje.

Fuentes oficiales: Verificar si la imagen ha sido publicada por medios de comunicación fiables o autoridades oficiales (Sedena, Fiscalía, Gobiernos Estatales).

Si solo aparece en cuentas anónimas de X (Twitter), Facebook o grupos de WhatsApp, duda de su veracidad.

Desconfía de la inmediatez: En situaciones de crisis, la desinformación se mueve rápido. Si la imagen se comparte sin contexto, ubicación exacta o con información vaga, suele ser falsa.

3. Señales de manipulación en “videos de pánico”

Movimientos antinaturales: En videos generados por IA (deepfakes), los movimientos pueden verse fluidos pero extraños, y las expresiones faciales pueden ser robóticas.

Contexto de años pasados: Frecuentemente se reciclan videos de operativos antiguos (de otros estados o años anteriores) y se presentan como actuales para generar caos, lo cual puede confirmarse mediante la búsqueda inversa.

4. Herramientas de ayuda

Detectores de IA: Sitios como Hive Detector pueden analizar imágenes para determinar si tienen alta probabilidad de ser generadas por IA.

Chequeadores de datos: Acude a medios especializados en verificación de hechos que suelen desmentir estas imágenes rápidamente.

Regla de oro: Ante una imagen impactante, dudar es la principal defensa. No compartas sin verificar su origen.

Texto y fotos: Manuel Pool